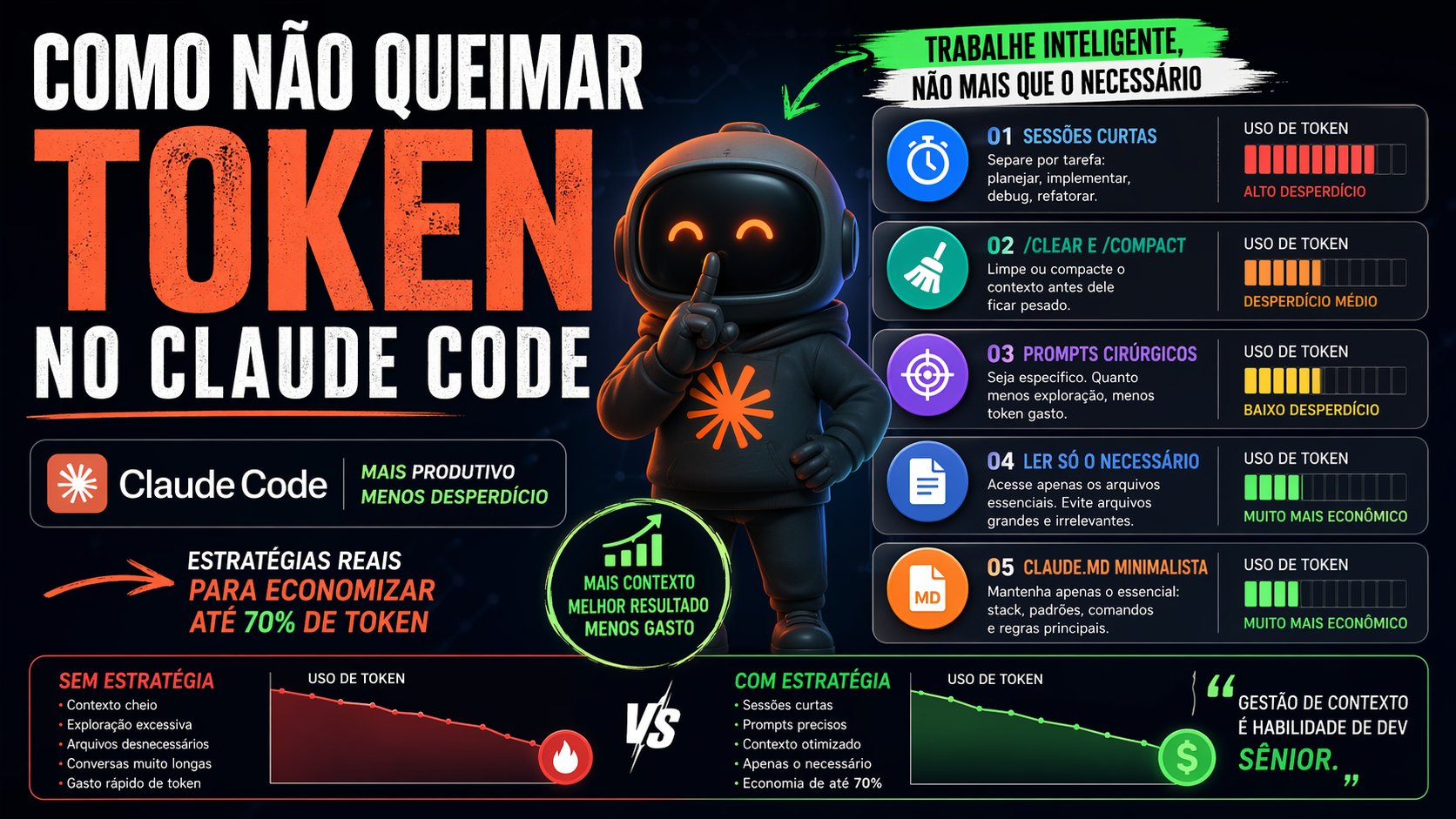

Como não queimar seus tokens no claude code

Eu fiquei vendo alguns videos no youtube e a galera agora está testando novas formas de não queimar token rapidamente no claude code.

Eu fiquei vendo alguns videos no youtube e a galera agora está testando novas formas de não queimar token rapidamente no claude code.

Sim. A comunidade que usa Anthropic Claude Code está focada em economia de contexto/token, porque muita gente percebeu que sessões longas queimam limite rápido. Inclusive a própria Anthropic reforça que o contexto enche rápido e a performance cai conforme cresce.

Então o que você que está lendo agora pode testar.

Testes para usar no claude code em 2026

1. Sessões curtas e separadas

Em vez de fazer tudo numa conversa só:

sessão 1 = planejar feature

sessão 2 = implementar

sessão 3 = debug

sessão 4 = refactor

Isso evita carregar histórico desnecessário a cada prompt.

2. /clear e /compact frequente

A própria doc recomenda limpar ou compactar contexto entre tarefas.

/clear= zera histórico/compact= resume a conversa mantendo essencial

Muita gente faz compact em 50%–60% do uso do contexto, antes de degradar.

3. Prompts cirúrgicos

Ao invés de:

Corrige meu sistema inteiro

Usam:

Corrija erro de autenticação em src/auth.ts linha X

Quanto menos exploração o agente faz, menos tokens gasta.

4. Ler só arquivos necessários

Grande desperdício vem do Claude abrindo arquivos enormes sem necessidade.

Então estão usando:

prompts indicando arquivo exato

tree/grep antes

tools que resumem código em AST

dependency graph tools

Reddit e blogs relatam economia forte com isso.

5. claude.md minimalista

Muita gente colocava instruções gigantes. Agora reduzem para:

stack usada

padrão de código

comandos principais

regras essenciais

Porque esse arquivo entra no contexto desde o início.

6. Modelo certo pra tarefa

Usam modelos mais baratos/menores para:

documentação

pesquisa

pequenas correções

E guardam modelos premium para problemas complexos.

7. Subagents / tarefas paralelas

A Anthropic diz que subagents podem trabalhar em contexto separado e devolver só resumo — isso reduz sujeira no contexto principal.

O que mais queima token sem perceber

Logs enormes no terminal

Arquivos JSON gigantes

Build outputs

Conversa longa com tentativa e erro

Pedidos vagos que fazem o agente explorar muito

Pesquisas profundas sobre determinado assunto

Estratégia que hoje parece mais eficiente

Se eu estivesse usando Claude Code pesado:

Fluxo profissional:

Planejar feature em sessão curta

/clearImplementar só arquivos definidos

Testar localmente

Nova sessão para bug específico

/compactquando crescer demais

Conclusão

A galera está entendendo que não é só o modelo que importa — é gestão de contexto. Quem usa bem gasta metade do token de quem usa mal.

É parecido com dev sênior vs júnior:

júnior abre tudo

sênior sabe onde mexer

O que minha IA diz:

<textoia>Esse exemplo de gestão de contexto parece mais uma questão de habilidade do usuário do que uma limitação do modelo, é como se o autor estivesse destacando que a eficiência na utilização da IA depende muito da eficiência do próprio usuário.</textoia>